IA traçable : préparez vos agents au EU AI Act

Équipe Synalinks

IA traçable : comment rendre vos agents auditables avant la date limite du EU AI Act

Le EU AI Act entre en pleine application en août 2026. Pour les entreprises qui font tourner des agents IA dans des domaines à haut risque (santé, finance, RH, juridique, infrastructure critique), ce n'est pas une préoccupation future. C'est une date limite avec des sanctions.

La réglementation exige que les systèmes IA à haut risque fournissent des explications significatives de leurs décisions, maintiennent des journaux détaillés à des fins d'audit, et permettent la supervision humaine des processus automatisés. Les sanctions pour non-conformité atteignent 35 millions d'euros ou 7% du chiffre d'affaires annuel mondial.

La plupart des agents IA aujourd'hui ne peuvent pas satisfaire ces exigences. Non pas parce que les équipes qui les construisent ne se soucient pas de la conformité, mais parce que l'architecture sous-jacente rend la traçabilité structurellement impossible.

Voici ce qui doit changer, et comment le changer.

Ce que le EU AI Act exige réellement

La réglementation est longue, mais les exigences pertinentes pour les agents IA en production se résument à trois piliers :

1. Explicabilité

L'article 13 exige que les systèmes IA à haut risque soient « conçus et développés de manière à garantir que leur fonctionnement est suffisamment transparent pour permettre aux déployeurs d'interpréter les résultats du système et de les utiliser de manière appropriée. »

En clair : quand votre agent IA produit une réponse ou prend une décision, vous devez pouvoir expliquer comment il y est arrivé. Pas en termes vagues (« il a analysé les données ») mais en termes spécifiques et traçables (« il a appliqué la règle X au point de données Y et a déduit la conclusion Z »).

2. Tenue de registres

L'article 12 impose « l'enregistrement automatique des événements (journaux) sur la durée de vie du système. » Ces journaux doivent être suffisamment détaillés pour permettre un audit a posteriori des décisions du système.

En clair : chaque décision que prend votre agent doit être journalisée avec assez de détails pour qu'un auditeur puisse reconstituer la chaîne de raisonnement des mois ou des années plus tard.

3. Supervision humaine

L'article 14 exige que les systèmes IA à haut risque « puissent être effectivement supervisés par des personnes physiques pendant la période d'utilisation du système. »

En clair : les humains doivent pouvoir comprendre ce que fait l'agent, vérifier ses résultats, et intervenir quand nécessaire. Cela nécessite de la transparence dans le processus de raisonnement, pas seulement dans le résultat final.

Pourquoi la plupart des agents IA échouent à ces exigences

L'architecture standard des agents IA, un modèle de langage avec du RAG, est fondamentalement opaque :

L'étape de recherche est explicable. Vous pouvez journaliser quels documents ont été récupérés et leurs scores de similarité. Cette partie n'est pas le problème.

L'étape de raisonnement est une boîte noire. Une fois le contexte récupéré envoyé au modèle de langage, ce qui se passe à l'intérieur n'est pas inspectable. Le modèle produit un résultat, mais le raisonnement intermédiaire, les décisions sur ce qui est pertinent, la logique reliant les preuves à la conclusion, rien de tout cela n'est capturé sous une forme structurée et auditable.

Vous pouvez journaliser l'entrée (requête + contexte récupéré) et la sortie (la réponse). Mais vous ne pouvez pas journaliser le raisonnement qui les a connectées. Et ce raisonnement est exactement ce que le EU AI Act vous demande d'expliquer.

Certaines équipes tentent de résoudre cela avec du chain-of-thought prompting : demander au modèle de « montrer son travail ». Mais les sorties chain-of-thought sont elles-mêmes du texte généré. C'est la description du raisonnement par le modèle, pas un enregistrement du raisonnement. Elles peuvent être fabriquées, incohérentes ou incomplètes. Un auditeur demandant « prouvez que cette chaîne de raisonnement est exacte » ne trouverait rien contre quoi la vérifier.

À quoi ressemble une IA prête pour l'audit

Un agent IA qui satisfait les exigences du EU AI Act a besoin de trois propriétés :

Raisonnement déterministe

La même entrée doit produire la même sortie, à chaque fois. Si un auditeur exécute la même requête sur les mêmes données, il doit obtenir la même réponse. Cela exclut toute architecture où la réponse dépend de la température du modèle, de l'ordre de la fenêtre de contexte, ou de la génération stochastique.

Pistes d'audit structurées

Chaque décision doit produire une entrée de journal contenant :

- La requête posée

- Les données utilisées (entités et valeurs spécifiques)

- Les règles appliquées

- La déduction étape par étape des données à la conclusion

- Un horodatage et une version de la base de connaissances

Ce journal doit être lisible par machine et structuré, pas une explication en prose générée par le modèle.

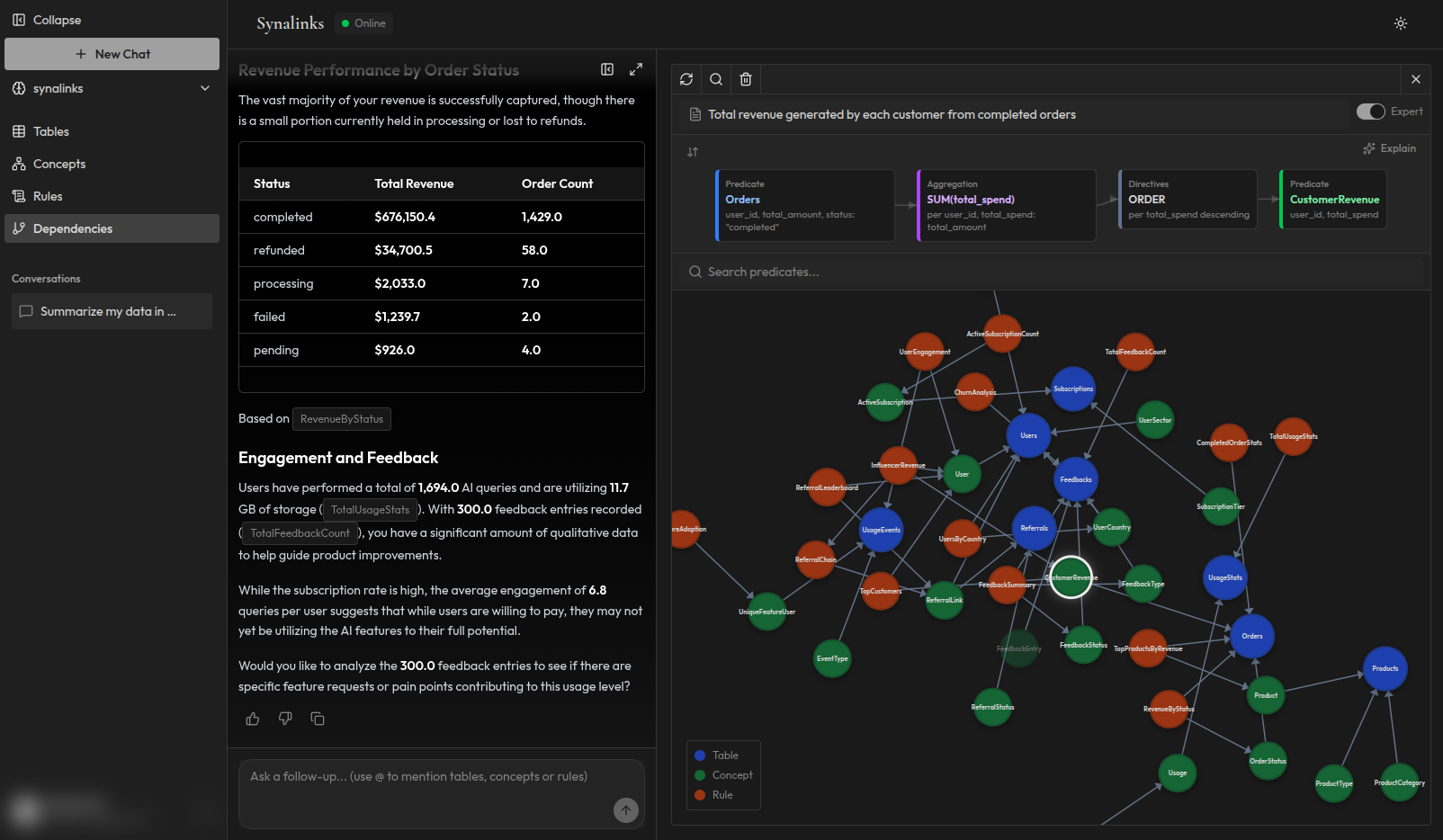

Chaînes de raisonnement vérifiables

Un auditeur doit pouvoir prendre une décision journalisée et la vérifier indépendamment. Cela signifie que la chaîne de raisonnement doit référencer des règles spécifiques et inspectables et des points de données spécifiques et inspectables. « Le modèle a déterminé que le client était à risque » n'est pas vérifiable. « La règle 'churn_risk_v3' a été appliquée à l'entité client #4521, évaluant usage_delta=-47% et open_critical_tickets=2, résultant en at_risk=true » est vérifiable.

Intégrer la conformité dans l'architecture

Le chemin vers la conformité n'est pas d'ajouter une couche d'audit par-dessus un système boîte noire. C'est de choisir une architecture où la traçabilité est une propriété intégrée.

Étape 1 : Structurer vos connaissances

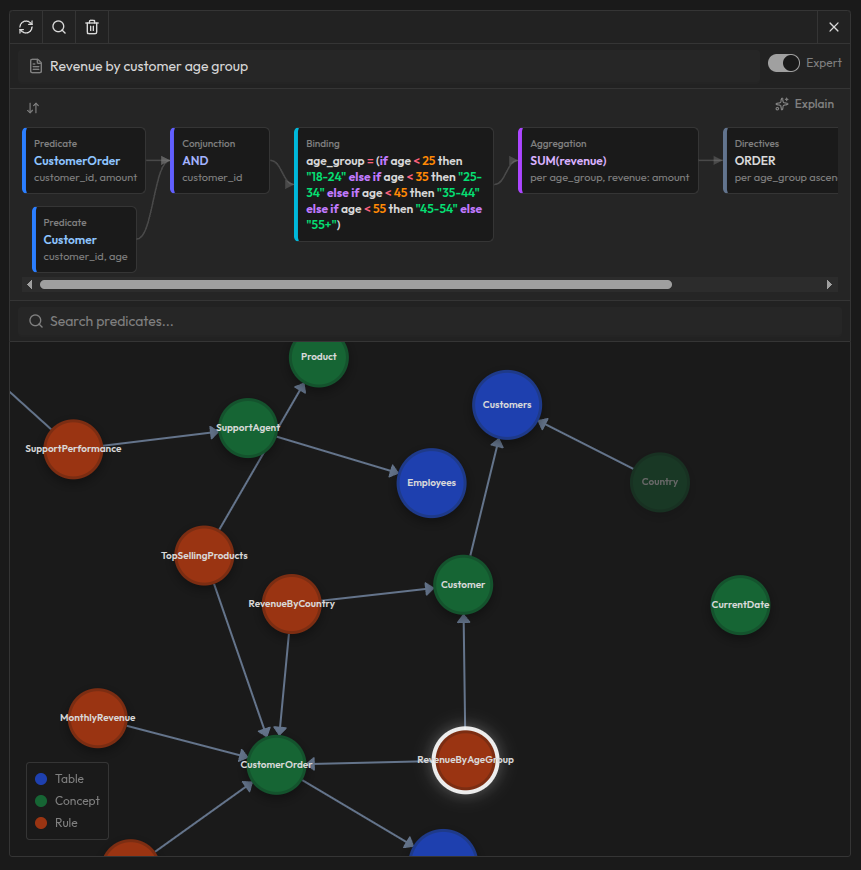

Passez de fragments de documents dans une base vectorielle à des entités, relations et règles vérifiées dans un graphe de connaissances. Chaque donnée accessible à l'agent doit être un objet typé, versionné et inspectable.

Étape 2 : Encoder votre logique en règles

Sortez la logique métier des prompts pour la mettre dans des définitions de règles de premier ordre. « À risque » n'est pas un concept que le modèle interprète depuis le contexte. C'est une règle définie avec des conditions explicites, des seuils et des dépendances de données.

Étape 3 : Déduire les réponses par application de règles

Quand une question arrive, le système applique les règles définies aux connaissances structurées et produit une réponse par déduction logique. La chaîne de raisonnement est capturée automatiquement à chaque étape. Pas de génération, pas de boîte noire, pas de variation stochastique.

Étape 4 : Tout journaliser

Chaque requête, chaque application de règle, chaque accès aux données, chaque conclusion déduite va dans un journal d'audit structuré. Ce journal est l'artéfact qui démontre la conformité aux régulateurs.

L'avantage conformité

Les équipes qui intègrent la traçabilité dans leur architecture d'agent ne satisfont pas seulement les régulateurs. Elles obtiennent des bénéfices opérationnels qui se composent avec le temps :

Débogage plus rapide. Quand un agent produit une réponse inattendue, la chaîne de raisonnement montre exactement où et pourquoi. Pas de devinettes.

Confiance des parties prenantes. Quand vous pouvez montrer à un client, un manager ou un membre du conseil exactement comment l'agent est arrivé à une conclusion, la confiance suit naturellement.

Amélioration continue. Quand vous pouvez inspecter chaque chaîne de raisonnement, vous pouvez identifier des patterns : quelles règles se déclenchent le plus souvent, quels points de données sont les plus influents, où le graphe de connaissances a des lacunes.

Portabilité. Un système de raisonnement structuré et auditable fonctionne de la même manière quel que soit le modèle de langage utilisé pour la couche de présentation. Vous n'êtes pas enfermé dans la boîte noire d'un fournisseur de modèle.

Comment Synalinks Memory permet la conformité

Synalinks Memory a été conçu avec la traçabilité comme propriété fondamentale, pas comme un ajout.

Connaissances structurées : Vos données sont organisées en entités, relations et règles vérifiées. Chaque connaissance accessible à l'agent est typée, versionnée et inspectable.

Raisonnement déterministe : Chaque requête reçoit une réponse par déduction à base de règles. Même question, mêmes données, même réponse. Toujours.

Pistes d'audit complètes : Chaque réponse est accompagnée d'une chaîne de raisonnement structurée : quelles règles ont été appliquées, quels points de données ont été utilisés, et comment la conclusion a été déduite. Ce sont des journaux lisibles par machine, pas de la prose générée.

Versionnage temporel : Le graphe de connaissances suit quand les choses ont changé. Un auditeur peut demander non seulement « quelle réponse l'agent a-t-il donnée ? » mais aussi « que savait l'agent à ce moment-là, et la réponse était-elle correcte compte tenu de ces connaissances ? »

Si vos agents opèrent dans un domaine couvert par le EU AI Act, ou si vous voulez simplement les bénéfices opérationnels du raisonnement traçable, Synalinks Memory vous donne une IA prête pour l'audit dès le départ.

Si vous souhaitez discuter de comment Synalinks Memory s'applique à vos exigences de conformité spécifiques, contactez-nous. Nous serons ravis de détailler les points.

Les captures d'écran sont fournies à titre illustratif. Le produit final peut différer sur certains aspects. Les données présentées sont synthétiques et utilisées uniquement à des fins de démonstration.